「今の生成AIって、どうしてあんなに自然に人間と会話できるんだろう?」 私たちが日常的に感じているその驚きの裏には、2017年に発表された「たった一つの革新的なアーキテクチャ」の存在があります。

毎週水曜日に開催されている社内向けの『AI SEMINAR』。今回はAIソリューションユニットの越田さんが登壇し、現代の生成AIの心臓部である「Transformer(トランスフォーマー)」の仕組みを紐解きました。

日々AIを実務で扱うエンジニアは、この技術のどこに凄みを感じ、そしてどんな未来を予測しているのか。コードの深淵からAI進化の限界までを探求した、濃密な1時間のレポートです。

すべての課題を“たった一つのアイデア”でぶっ壊した革命

「自然言語(言葉)って、画像や音声と違って連続性がないから、そもそもAIにとって学習しづらい『扱いにくいデータ』なんです」

越田さんの解説は、AIが言葉を理解する根本のメカニズムから始まりました。言葉を「トークン」という単位に切り刻み、それを高次元の数値ベクトルに変換(Embedding)することで、初めてAIは言葉を「微分(計算)」できるようになります。

2017年にTransformerが登場するまで、言語処理の主役は「RNN」と呼ばれるモデルでした。しかしRNNには、「前の単語の計算が終わるまで次の計算ができない(並列処理ができない)」「文章が長くなると最初の方を忘れてしまう」という致命的な弱点がありました。

「でも、Transformerはこれらすべての問題を一気に解決してしまったんです」

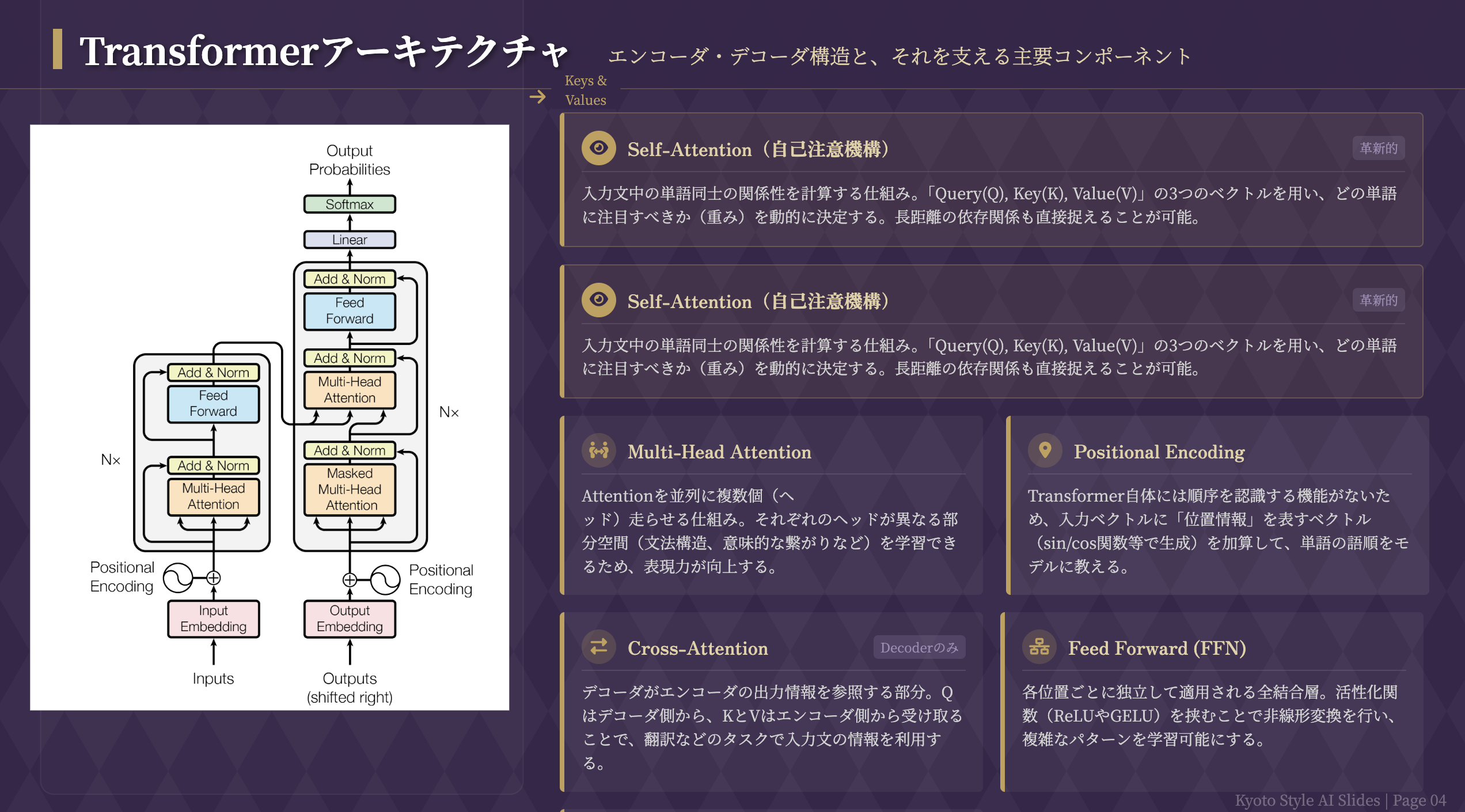

その魔法の正体が、「Attention(注意機構)」という仕組み。文章を頭から順番に読むのではなく、「文章全体の情報を一括で見渡し、どの単語とどの単語の結びつきが強いかを一気に計算し、混ぜ合わせる」というアプローチです。これにより、AIは長文の文脈を見失うことなく、かつGPUのパワーを使って超高速で学習することが可能になりました。

スライドじゃ足りない! コードで見せる「情報の混ざり合い」

「せっかくなんで、実際にどういう処理が流れているか実演で見せたいと思います」

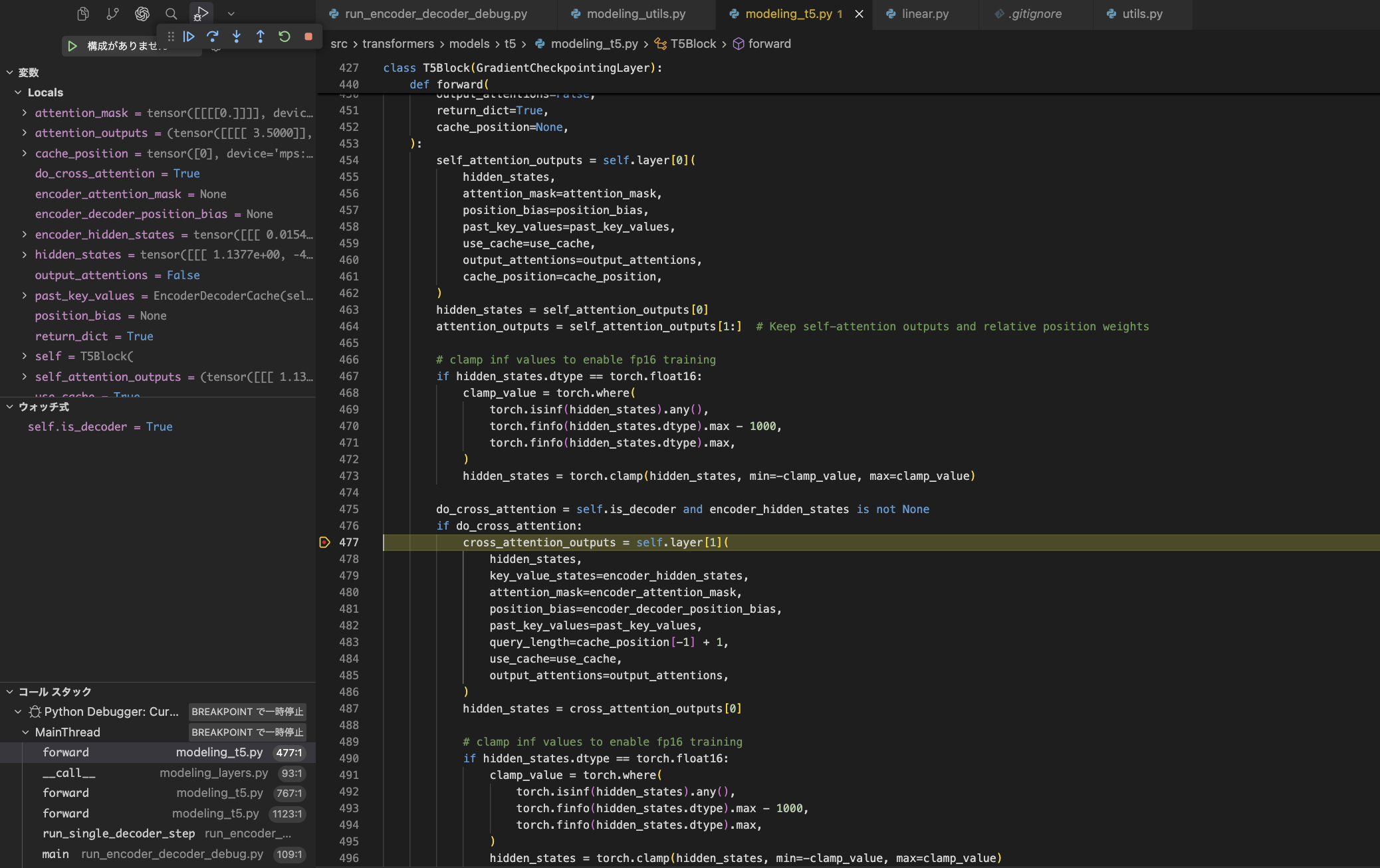

ここで越田さんはスライドを閉じ、なんとAIモデルの開発プラットフォーム「Hugging Face」の実装コードを画面に映し出しました。

「ここがEncoderに入っていくところで……ここでAttentionの計算をしています。ここで情報を『混ぜ合わせて』いるんです」

ブレークポイントを打ちながら、複雑なAIの内部でパラメータ(数値の羅列)がどのように更新され、次の層へと受け渡されていくのか。ブラックボックスに思われがちなAIの「脳内」を、現場のエンジニアならではのライブデバッグで生々しく解き明かしていく姿に、参加者も画面に釘付けになりました。

エンジニアも首を傾げる「スケーリング則」の異常さ

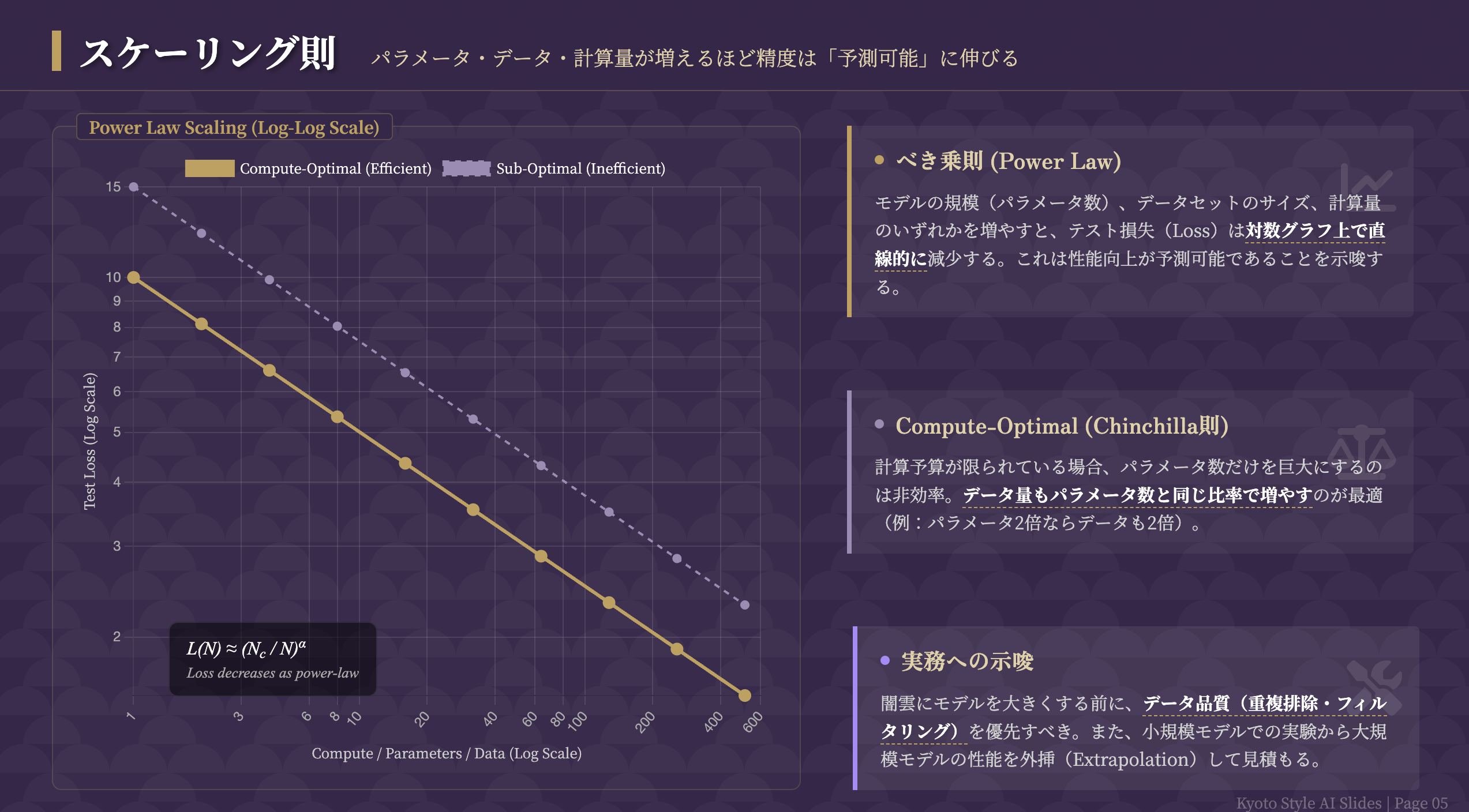

越田さんがさらに探求心を覗かせたのが、今のAIブームを牽引する「スケーリング則」です。パラメータやデータ量を増やせば増やすほど、AIの精度が予測通りに一直線に伸びていくというこの法則。

「これ、実は結構不思議な現象なんです。従来のAIモデルって、複雑にしすぎると『過学習』を起こして逆に精度が下がってしまうことが多かった。でも、大規模言語モデルではそれが起こらないように見える。それがすごい不思議だなと」

事実、Meta社の最新モデルなども「ひたすらデータとスケールを大きくしただけ」と明言されており、力技で賢くなるAIの異常な進化スピードに対するエンジニアとしての率直な驚きが語られました。

2028年、AIは「食べるデータ」を失う?

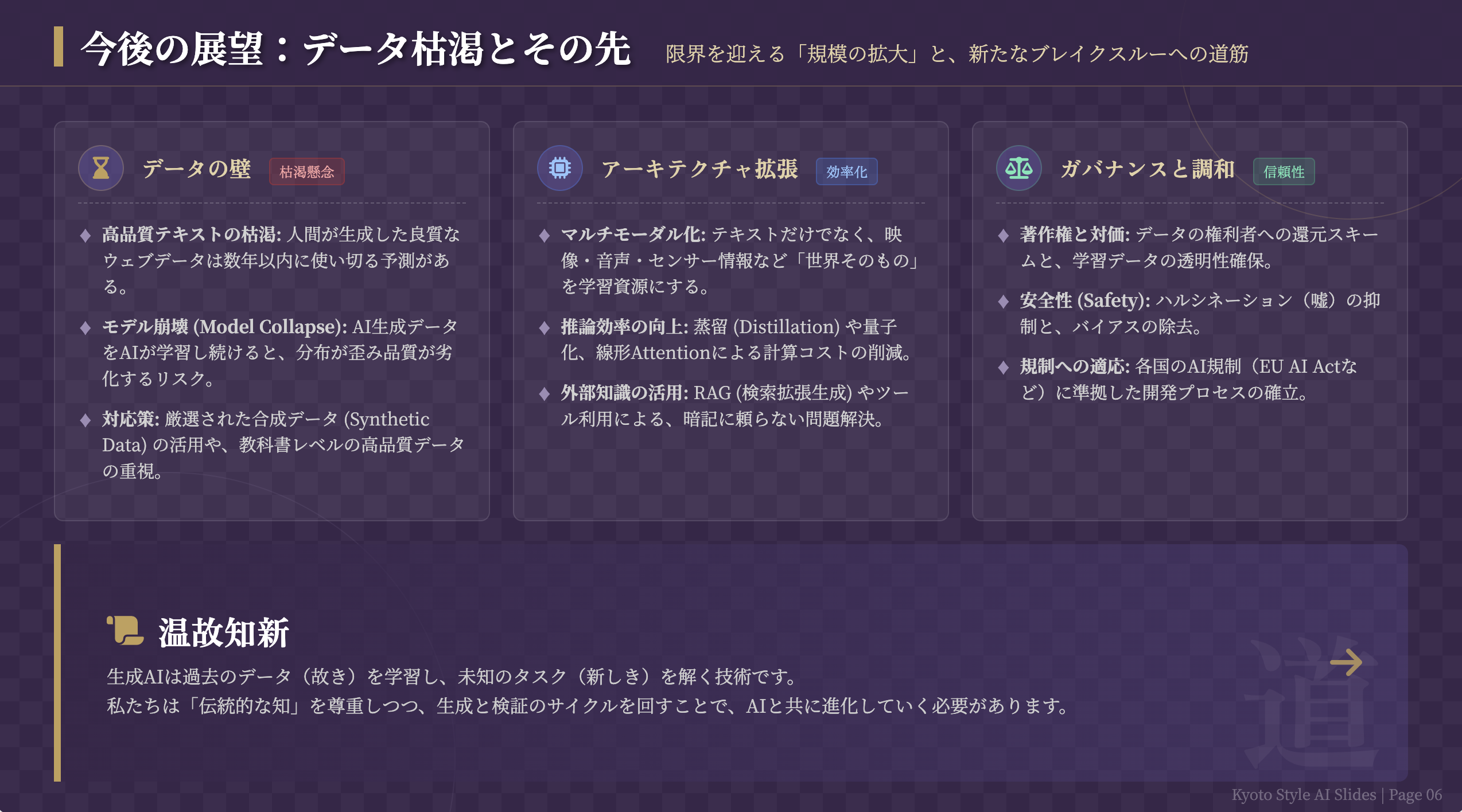

しかし、この力技の進化も永遠ではありません。越田さんは一つの論文を引き合いに出し、衝撃的な未来を提示しました。

「実は、早ければ2028年に、インターネット上にある高品質な学習データが食い尽くされてしまうという予測があるんです。AIがデータを食う速度が、インターネット上にデータが増える速度よりも早いから」

データを増やせば賢くなるなら、データが無くなったらどうなるのか? 「だからもう、単純にサイズを大きくするアプローチは限界が来ます。テキスト以外の映像や音声を使うマルチモーダル化や、RAG(検索拡張生成)による外部知識の活用など、『新しいパラダイム』へ移行する時期に来ているんです」

イノベーションの正体は「温故知新」

質疑応答では、「AIって全然わからないんですけど…そもそもデータってどういう形式で食わせてるんですか?」「パラメータってどういう意味があるんですか?」といった他部署のメンバーからの素朴な疑問が飛び出し、越田さんがコードを交えながら丁寧に答える一幕も。職種や知識レベルの壁を越えて、テクノロジーへの知的好奇心をぶつけ合えるのは、当社の『AI SEMINAR』ならではの光景です。

「実はTransformerを構成する要素自体は、昔からある技術の組み合わせなんです。みんなが当然のように使っていたものを、すごい組み合わせ方で統合した結果、大ブレイクスルーが起きた」

過去の知見を組み合わせ、全く新しい価値を生み出す。越田さんが最後に語った「温故知新」の言葉は、AIの進化だけでなく、私たちのプロダクト開発の姿勢そのものを表しているようでした。

「どうやってこの技術を実務に活かすか」「次はローカルLLMを触ってみよう」。 セミナー終了後も熱冷めやらぬ議論が続いた夜。私たちはこれからも、テクノロジーの最前線を探求し続けます。

編集後記

「AIが言葉を理解するとはどういうことか?」という根源的なテーマから、未来のAI開発のトレンドまで、一人のエンジニアの探求心を通して見えてきた今回のセミナー。当社では、技術への強い興味を持ち、未来の「当たり前」を共に創る仲間を募集しています。興味を持たれた方は、ぜひ採用ページも覗いてみてください。