「AIは便利だけど、機密情報はアップロードできない」「クラウドのAPI利用料が毎月かさむ…」。そんな悩みを一掃する技術として、今エンジニアやビジネスの現場で熱視線を浴びているのが「ローカルLLM」です。

2026年4月15日に開催された社内セミナー『AI関連のセミナー・ライトニングトーク』では、当社の育成担当である滝川雅晴が登壇しました 。エンジニア出身であり、日々の業務にAIを積極的に取り入れる育成担当という独自の視点から、「なぜ今ローカルLLMがアツいのか」、その技術的背景からビジネスの最前線までを約30分で解説しました 。その熱いトークの内容を凝縮してお届けします。

1. クラウド依存からの脱却。「手元のAI」が持つ圧倒的メリット

ローカルLLMとは、ChatGPTなどの外部クラウドサービスに依存せず、自分のPCや社内サーバーなどのローカル環境で動かすことができる大規模言語モデルのことです 。

セミナー冒頭、滝川はローカルLLMがもたらすメリットを次のように語りました。

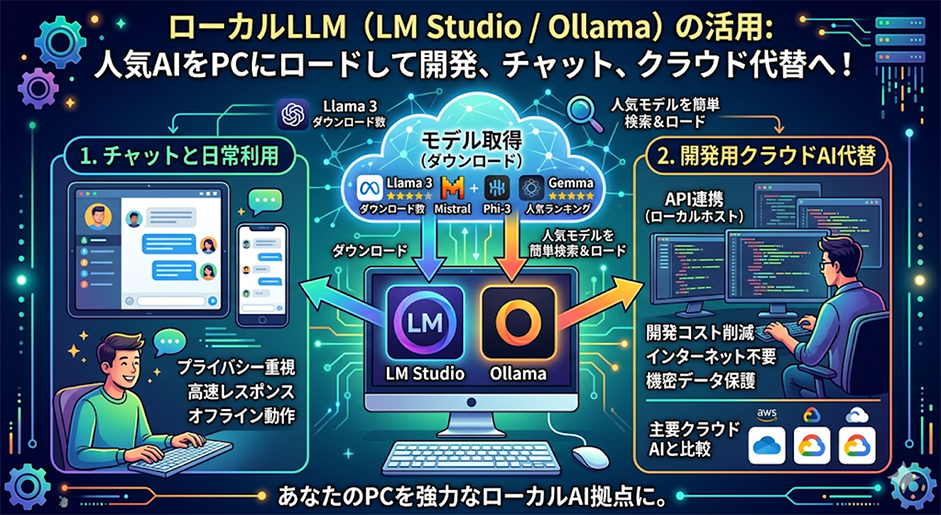

- ・コスト削減:月額料金やAPIの従量課金が不要で、自環境のデバイスで動かすことができる 。

- ・データのプライバシー:外部にデータを送信しないため、情報漏洩のリスクなくセキュアに完結する 。

- ・オフライン実行:インターネット接続なしで動作する 。

滝川は「万が一、海底ケーブルが切断されてクラウドが停止するような事故が起きても、ローカルLLMなら頼もしく稼働し続ける」と冗談交じりに語り、オフラインで自律的に完結する強みを強調しました 。

2. なぜ今なのか? 数百GBを数GBに縮める「圧縮革命」

では、なぜ最近になってローカルLLMがこれほど盛り上がっているのでしょうか。その背景には、単なるブームではない技術的なブレイクスルーとハードウェアの進化があります 。

- ・量子化と知識蒸留:モデルのパラメータ精度をあえて落としたり、知能のパターンを抽出して凝縮したりすることで、実用的な性能を維持したまま、かつて数百GBあったファイルサイズを数GBにまで劇的に縮小することに成功しました 。

- ・ハードウェアの進化:Apple Silicon(MacのMシリーズ)の統合メモリの仕組みや、WindowsのゲーミングPCに搭載されているNVIDIA RTX(ビデオメモリ)が、ローカルLLMを動かすのに最適な「AIサーバー」として活躍しています 。

特に大きなブレイクポイントとなったのが、2025年8月にOpenAIから発表されたオープンソースモデル「gpt-oss(20B・約12GB)」です 。さらに直近の2026年4月2日には、Googleから「Gemma 4(E4B・約6GB)」が登場しました 。 滝川によれば、「この半年間で必要なメモリサイズが半減したのに、性能は同等かそれ以上」というパラダイムシフトが起きています 。

3. 「ケチケチエンジニア」も歓喜? 開発と業務の新しいスタイル

実行環境の標準化も進んでおり、現在では「LM Studio」や「Ollama」といったクライアントツールを使えば、誰でも直感的に人気モデルをダウンロードしてチャットを開始できます 。

- ・RAG(検索拡張生成)の構築:世間に出回っていない独自の社内ドキュメントを読み込ませるRAGも、「Dify」などのプラットフォームを使えば、ローカル環境内でセキュアかつ簡単に設定可能です 。

- ・バイブコーディングの実現:ローカルLLMをパソコン内でローカルサーバーとして起動し、CursorやCodex CLIなどと接続することで、AIコーディング支援を利用することもできます 。

滝川自身も「僕みたいなケチケチエンジニア向けに、一銭もお金をかけずに動かしたい人には最適」と笑いを誘いつつ、API課金を無料のローカル環境に代替できる実用性をアピールしました 。

4. ローカルLLMが切り拓く、新たなビジネスと未来

この技術の進化は、すでにビジネスの現場に大きな波を起こしています。

- ・コンサル・SIビジネス:MoMo社やAthena Technologies社などは、機密情報を外部送信しない環境での銀行業務効率化(稟議書レビューなど)や、閉域環境下でのロボット制御PoCを推進しています 。

- ・プラットフォーム・インフラ提供:OpenBridge社の「BridgeDocs AI」のような社内ナレッジ基盤や 、NTTの「tsuzumi」、NECの「cotomi」といったエンタープライズAI基盤が台頭しています 。なお、NECはデジタル庁のガバメントAIにも選定されています 。

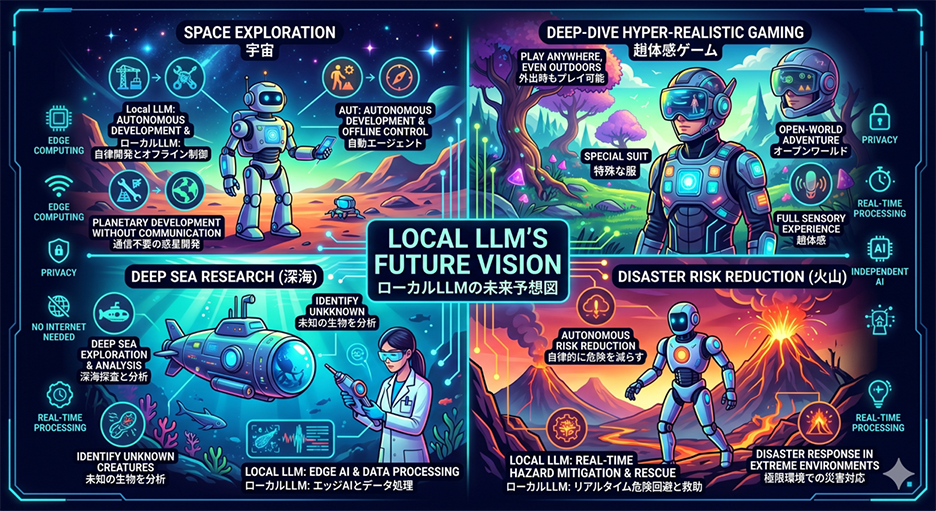

さらにその先には、通信が届かない「深海探査」や「宇宙産業」、「自然災害時」の危険回避と救助、さらには「農業」や「ロボティクス」への組み込みなど、オフラインのエッジAIとしての果てしない未来予想図が広がっています 。

「AIは『クラウドのサービス』から『配布されるソフトウェア』へと変化している」 。 この言葉が示す通り、企業や個人が主権を持ち、自分たちの手元でAIを育て、動かす時代がすぐそこまで来ています。

編集後記

今回のセミナーは、普段は新入社員研修などを担当し、技術と人を繋ぐ育成担当の滝川ならではの、非常にわかりやすく熱量の高いセッションでした。クラウドAI一強と思われがちな昨今ですが、セキュリティ要件やコスト、そして「どこでも動く」という強みを持つローカルLLMは、私たちのソリューション提案にも新たな武器をもたらしてくれそうです。

当社では現在、こうした最新技術のキャッチアップを楽しみながら、ビジネスや組織作りに還元していける仲間を募集しています。少しでも興味を持たれた方は、ぜひ採用ページを覗いてみてください。